Рандомизированные несравнительные исследования – оксюморон или реальная польза

Доклад на сессии “Диалоги клинициста со статистиком – проблемы восприятия результатов клинических исследований” на Российском онкологическом конгрессе (РОК) 2025.

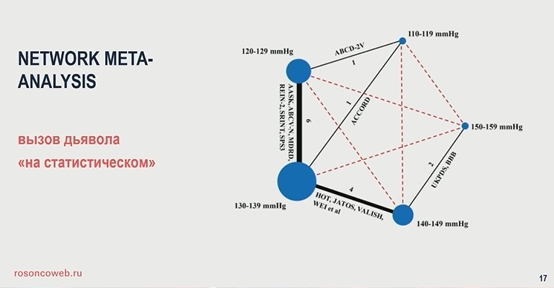

Подобная сессия проводилась на РОКе впервые, хотя он уже был 19-ый по счёту. Сессии на статистические темы на нём при этом были и до этого – только обсуждались они клиницистами без привлечения статистиков 🙈. Да, с мемасами вроде того, что на фото ниже (из презентации с РОКа 2024 г., где врачи обсуждали непрямые сравнения), но, как по мне, штуки были не совсем безобидные и звучали в духе “запугай врача статистиком” и явно не способствовали развитию какого бы то ни было диалога.

💡 Идея сессии “Диалоги клинициста со статистиком” родилась из моего обсуждения в чате с онкологами такого явления, как “рандомизированные несравнительные исследования”. Собственно, я впервые о таком “инновационном дизайне” узнала именно в этом чате. Первой реакцией с моей стороны было нечто вроде “эээээ, а как это вообще???”, потому что рандомизация воздействия и делается-то прежде всего для того, чтобы корректным образом оценить сравнительный эффект… Слово за слово – и мне предложили представить свою позицию на РОКе.

🤔 Если честно, меня сразу резанул диссонанс между “диалогом”, заявленным в названии, и форматом сессии, столь популярным на РОКе, в виде баттла, в котором свое мнение по вопросу представляет вначале онколог, а потом статистик, выступая тем самым в роли “ответчика”, пытающегося оправдаться перед онкологами, с точки зрения которых статистические методы и дизайны вполне можно применять офф-лейбл (для решения совершенно не тех проблем, для решения которых этот инструмент предназначен). Но хозяин – барин, поэтому с форматом сессии пришлось смириться и радоваться хотя бы тому, что она вообще появилась в сетке.

На этой страничке можно найти видеозаписи каждого выступления на сессии.

🥞 Первый блин комом Ну, а получилось из этого то, что получилось. Были и стандартные “шуточки” в адрес статистиков о том, что всё у клиницистов было хорошо, пока не пришли статистики и не рассказали онкологам, что они всё сделали неправильно. Немножко успокаивает, что их было не так много (не все вопросы на сессии были столь дискуссионными, как достался мне).

❗ Дорогие клиницисты, принимающие критику выбранных вами дизайнов, инструментов и интерпретаций за критику лично в ваш адрес, статистики (если они профессионалы своего дела, конечно, потому что, как и врачи, они бывают разными) в подобных случаях говорят обычно всё-таки не о вас, а о том, что выбранный вами дизайн, инструмент, интерпретация вам же самим не позволяют ответить на ваш же исследовательский вопрос. И если какой-то фейл, особенно сделанный в самом начале исследования, потом приводит к тому, что в действительности, как бы вам того ни хотелось, вы не получаете ответ на нужный вам вопрос или не получаете корректный ответ на него, статистикам от этого тоже не то чтобы весело. Пустили слезу? Ну вот как если бы вы поняли, что до вас пациенту неверно поставили диагноз, назначили не то лечение или вовсе оставили без него. Или пациент лечился по советам из чатаГПТ. Вы бы его отпустили заблуждаться дальше, похлопав по плечу: “Не переживайте, вы всё делаете правильно, продолжайте дальше”?

🤔 Поэтому, честно, не очень понятно стремление клиницистов убедить статистиков в том, что им, клиницистам, виднее, как эту статистику “готовить”. Во многом расхожесть фразы про ложь, большую ложь и статистику как раз связана с недостаточной погруженностью в тему и каким-то глобальным недоверием профессионализму статистиков (впрочем, я врачам тоже не всем своё здоровье доверю). Если бы хотя бы это сопровождалось корректной аргументацией, без “у нас все так делают и вообще статья в Ланцете была опубликована”. Особенно огорчила отсылка к статистику-укажаемому-профессору-в-возрасте, адепту рандомизированных несравнительных исследований, которого мы, вступившие в этот “диалог” статистики, даже “не читали, но осуждаем”, и рекомендация нам самим внутри себя разобраться и выработать какой-то единый взгляд на подобные проблемы. А пока, видимо, клиницисты, которые, надо думать, выступают всегда единым фронтом по своим профессиональным проблемам, оставляют за собой право самим судить, насколько корректно была решена та или иная задача с помощью выбранного ими статистического инструмента.

🔥 Приведу цитаты из поста статистика Даррена Дэли 5-летней давности – очень уж они в тему:

So the problem isn’t simply about the time wasted refuting bullshit — it’s about degrading the trust you have in an already insufficient amount of statistical expertise (relative to needs). So when a statistician points out to a clinical colleague a statistical error that has been published by “top people in a top journal” they risk not being taken seriously. They risk not being included in the next project. They risk one investigator telling another, “I wouldn’t work with them…they don’t really seem to know what they are doing.”

Every time I have to have a conversation to advise a clinical colleague against one of these practices, I feel like I am fighting against hordes of established experts who have repeatedly published studies using these methods, screaming “What does he know!? I have 5 trials published in NEJM!”

To be clear, I’ve thus far been blessed to work with researchers that by and large allow and encourage me to contribute my expertise to their research. But the few that aren’t like this are very challenging to deal with. Then you start adding in the seemingly endless flow of asinine comments about statistics from reviewers (on grants and papers), and it starts to wear you down. Every wrong-headed suggestion means that I might need to first convince my collaborators that the suggestion is baseless, and then we have to start the dance of side-stepping their bad advice while still somehow satisfying the reviewer. It’s a constant slog. It would be so much easier to just do things the wrong way, or hide in a hole writing methods papers, leaving one fewer applied-statistician, dejected and downtrodden, to “t and p” your data.